AI is geen doel op zich

De belofte van Copilot was helder. Minder handwerk. Sneller werken. Slimmere ondersteuning. In de praktijk blijkt dat niet elke AI-functie ook echt waarde toevoegt. Gebruikers ervaren ruis. IT-teams zien extra beheer. Security en privacy officers stellen terechte vragen over datagebruik en logging.

Microsoft luistert nu nadrukkelijker naar die signalen. Dat is positief. Maar het laat ook zien dat standaard AI-integraties niet automatisch passen bij elke organisatie.

Voor jouw IT-strategie betekent dit iets belangrijks. AI moet een middel zijn. Geen standaardlaag die je er blind overheen legt.

Wat speelt er concreet bij Windows 11

De discussie rondom Recall maakt veel los. Continu screenshots opslaan om later context terug te vinden klinkt handig. Maar het roept direct vragen op over privacy, dataminimalisatie en AVG-compliance. Zeker in Nederlandse organisaties waar gevoelige data dagelijks op schermen verschijnt.

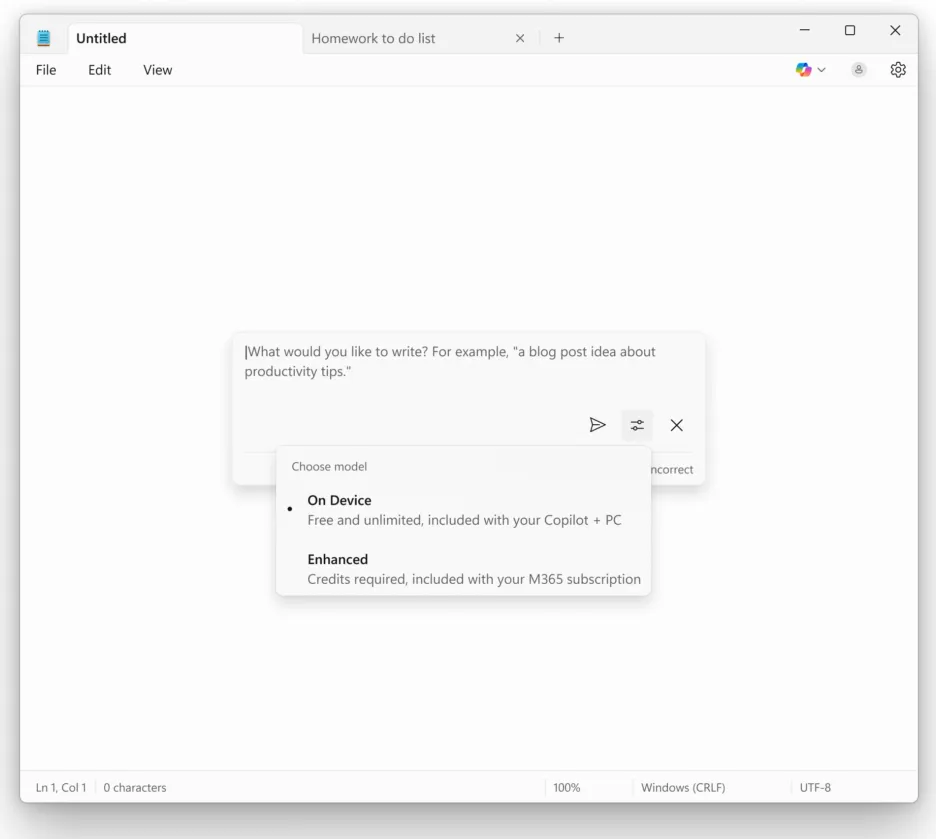

Ook kleinere Copilot-functies in standaardapps blijken niet altijd gebruikt te worden. Of ze leveren te weinig op in verhouding tot de risico’s en complexiteit die ze introduceren.

Microsoft overweegt daarom om functies te schrappen, te beperken of anders te positioneren. Minder prominent. Meer opt-in. Meer controle bij de gebruiker en de organisatie.

Dat past bij een bredere trend. AI verschuift van hype naar selectie.

AI-functie in Kladblok

Wat betekent dit ?

Voor organisaties in Nederland is dit hét moment om scherper te kijken naar hun AI-keuzes. Niet wat kan er, maar wat voegt echt iets toe.

Een paar vragen die je jezelf moet stellen:

- Welke AI-functionaliteiten worden daadwerkelijk gebruikt door medewerkers?

- Welke data wordt verwerkt en waar staat die data?

- Past dit binnen onze AVG-risicoanalyse?

- Wie is verantwoordelijk voor beheer, monitoring en incidenten?

- Levert het meetbare tijdwinst, kwaliteitsverbetering of risicoreductie op?

Zonder duidelijke antwoorden wordt AI al snel een extra laag complexiteit. En complexiteit kost geld, tijd en focus.

AI vraagt om regie, niet om standaardinstellingen

Wat we nu zien bij Microsoft Copilot bevestigt een punt dat wij vaker maken. AI werkt alleen goed als je regie neemt. Dat betekent bewuste keuzes maken. Functies aanzetten die passen bij je processen. Functies uitzetten die dat niet doen.

In veel Microsoft-omgevingen staat AI inmiddels op meerdere plekken klaar. In Windows. In Microsoft 365. In security tooling. Zonder duidelijke kaders ontstaat versnippering.

Voor IT-managers en directies is dit een governance-vraagstuk. Wie bepaalt wat wel en niet wordt gebruikt. Op basis van welke criteria. En hoe borg je dat dit ook zo blijft na updates.

De rol van compliance en security

In Nederland speelt compliance altijd mee. AVG is geen vinkje. Het is een continu proces. AI-functionaliteiten die automatisch content analyseren, samenvatten of opslaan, raken direct aan privacyprincipes zoals dataminimalisatie en doelbinding.

Daar komt bij dat leveranciers hun AI-modellen blijven aanpassen. Wat vandaag lokaal lijkt te draaien, kan morgen anders zijn ingericht. Zonder monitoring loop je achter de feiten aan.

Daarom moet AI onderdeel zijn van je security- en compliancebeleid. Net zoals identity, logging en endpoint management dat zijn.

De aanpak van ALTA-ICT

Bij ALTA-ICT helpen wij organisaties om AI praktisch en beheersbaar in te zetten. Geen experimenten zonder einddoel. Geen functies omdat ze nieuw zijn. Maar keuzes die passen bij de organisatie.

Wij helpen met:

- Praktische AI-toepassingen die medewerkers echt gebruiken.

- Risicobeheersing rond privacy, data en compliance.

- Integratie binnen bestaande Microsoft-omgevingen.

- Heldere afwegingen. Wat wel. Wat niet. En waarom.

Vanuit onze ISO27001 en ISO9001 aanpak zorgen we dat AI geen los project is, maar onderdeel wordt van je IT-governance. Met duidelijke kaders, documentatie en monitoring.

Wat je nu al kunt doen

Wacht niet tot leveranciers beslissen wat blijft en wat verdwijnt. Gebruik dit moment om zelf de regie te pakken.

- Inventariseer welke AI-functies actief zijn in je Microsoft-omgeving.

- Evalueer het gebruik en de toegevoegde waarde.

- Betrek security en privacy vanaf het begin.

- Maak keuzes expliciet en leg ze vast.

- Communiceer helder naar gebruikers wat de bedoeling is.

Zo voorkom je dat AI iets wordt wat je overkomt in plaats van iets wat je helpt.

Tot slot

De twijfel van Microsoft over Copilot in Windows 11 is geen zwakte. Het is een reality check. AI is krachtig, maar alleen als het past bij je organisatie, je mensen en je verantwoordelijkheden.

De vraag is dus niet of je AI moet gebruiken. De vraag is hoe bewust je dat doet.

Moet AI standaard in tools zitten, of alleen daar waar het aantoonbaar waarde toevoegt voor jouw organisatie?